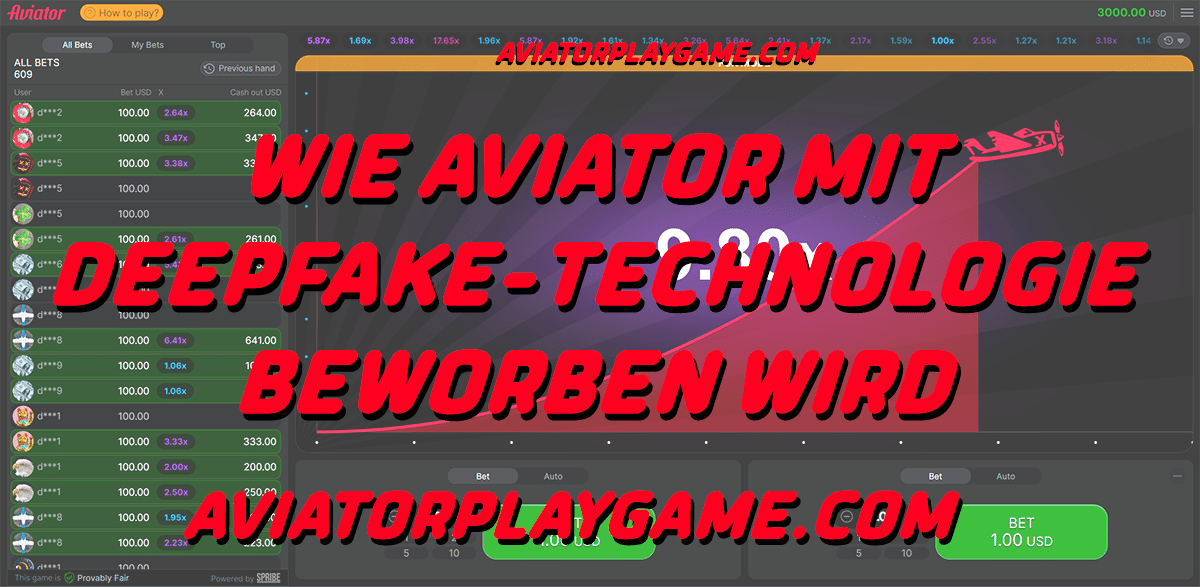

Wie Aviator mit Deepfake-Technologie beworben wird

Die rasante Entwicklung der künstlichen Intelligenz (KI) und der Deepfake-Technologie hat neue Möglichkeiten für Marketing und Werbung eröffnet, aber auch zu einem beunruhigenden Trend geführt: die unerlaubte Verwendung von Prominentenbildern, um für Glücksspiel-Apps zu werben, darunter auch für das immer beliebtere Spiel Aviator. In den letzten sechs Monaten sind mehrere Berichte aufgetaucht, die zeigen, wie die Deepfake-Technologie ausgenutzt wird, um überzeugende, aber betrügerische Werbung mit bekannten Prominenten zu erstellen, die Aviator und ähnliche Glücksspielplattformen unterstützen.

Verständnis der Deepfake-Technologie

Die Deepfake-Technologie nutzt künstliche Intelligenz und Algorithmen des maschinellen Lernens, um äußerst realistische Video-, Audio- oder Bildaufnahmen zu erstellen, die zwar echt zu sein scheinen, in Wirklichkeit aber komplett gefälscht sind. Diese Technologie ist in der Lage, das Gesicht einer Person auf einen anderen Körper zu übertragen, ihre Stimme nachzuahmen und sogar völlig neues, authentisch wirkendes Filmmaterial zu erstellen. Während Deepfakes in der Unterhaltung und in den Medien einige positive Anwendungen haben, ist ihr Missbrauch in der Werbung – insbesondere in der Glücksspielbranche – zu einem großen Problem geworden.

Der Fall Aviator und die Deepfakes von Prominenten

Aviator, ein Crash-Spiel, das sich in Online-Glücksspielkreisen großer Beliebtheit erfreut, ist zur Zielscheibe für unethische Vermarkter geworden, die mit Deepfakes für das Spiel werben. Deepfake-Werbung mit Prominenten wie MrBeast, Akshay Kumar und Virat Kohli kursiert in den sozialen Medien und gaukelt dem Publikum vor, dass diese Persönlichkeiten das Aviator-Spiel befürworten.

MrBeast und die Glücksspiel-App

Im Oktober 2023 verurteilte MrBeast, einer der einflussreichsten YouTuber mit Millionen von Followern, öffentlich ein Deepfake-Video, in dem er fälschlicherweise für eine Glücksspiel-App warb. Das Video war raffiniert gestaltet und verwendete fortschrittliche KI-Techniken, um das Aussehen und die Stimme von MrBeast zu imitieren, so dass es so aussah, als würde er die App wirklich befürworten. In der Werbung wurde fälschlicherweise behauptet, dass die BenutzerInnen beim Spielen der Glücksspiele beträchtliche Geldbeträge gewinnen könnten, und die ZuschauerInnen wurden dazu verleitet, die App herunterzuladen und Wetten abzuschließen (Vegas Slots Online).

MrBeast warnte seine Fans in den sozialen Medien vor dem Betrug, rief sie zur Vorsicht auf und stellte in Frage, ob die sozialen Medienplattformen auf die wachsende Bedrohung durch KI-Depfakes vorbereitet seien. Seine Aussage warf ein Schlaglicht auf die allgemeine Frage, wie leicht diese Technologie missbraucht werden kann, insbesondere im Glücksspielsektor, wo Vertrauen und Glaubwürdigkeit entscheidend sind, um neue Nutzer zu gewinnen.

Lots of people are getting this deepfake scam ad of me… are social media platforms ready to handle the rise of AI deepfakes? This is a serious problem pic.twitter.com/llkhxswQSw

— MrBeast (@MrBeast) October 3, 2023

Akshay Kumar’s Deepfake-Dilemma

In ähnlicher Weise wurde der Bollywood-Schauspieler Akshay Kumar ein weiteres Opfer des Deepfake-Missbrauchs. Im August 2023 begann ein Video in den sozialen Medien zu kursieren, in dem Kumar scheinbar eine Glücksspielanwendung in Verbindung mit dem Spiel Aviator befürwortete. Das Deepfake-Video wurde erstellt, indem der Ton und die Lippenbewegungen eines echten Videos von Kumar, in dem er für seinen Film „OMG 2“ wirbt, verändert wurden. Das manipulierte Video gaukelte den Zuschauern vor, dass der Schauspieler das Aviator-Spiel befürwortet – eine Behauptung, die Kumar und sein Team schnell widerlegten (FACTLY).

Dieser Vorfall unterstreicht die Raffinesse der Deepfake-Technologie und die Leichtigkeit, mit der sie zur Manipulation von Inhalten für schändliche Zwecke eingesetzt werden kann. Kumars Team leitete rechtliche Schritte gegen die Urheber des Deepfakes ein, aber der Schaden für seinen Ruf und der potenzielle Schaden für ahnungslose Zuschauer war bereits angerichtet.

Außerdem haben wir das virale Video den Deep Fake Video Detectors unterzogen, die es als potenzielle Fälschung identifiziert haben.

Virat Kohli und die Aviator-Werbung

In einem weiteren alarmierenden Fall tauchte ein gefälschtes Video des indischen Kricket-Stars Virat Kohli auf, der für das Spiel Aviator wirbt. Das Video nutzte KI-Technologie, um Aufnahmen aus einem echten Interview mit Kohli so zu verändern, dass es so aussah, als würde er die Glücksspiel-App befürworten. Dieses Deepfake war besonders überzeugend, weil es eine Technologie zum Klonen der Stimme von Kohli enthielt, die der betrügerischen Werbung einen Hauch von Authentizität verlieh (FACTLY).

Wie die anderen Prominenten, auf die es abgesehen war, hatte Kohli keine Kenntnis von der Werbung für das Aviator-Spiel und war auch nicht daran beteiligt. Der Deepfake führte nicht nur die Fans in die Irre, sondern stellte auch ein erhebliches Risiko für diejenigen dar, die aufgrund der falschen Befürwortung zum Herunterladen und zur Nutzung der App verleitet werden konnten.

Die Auswirkungen von Deepfake-Werbung

Die Verwendung von Deepfakes zur Werbung für Glücksspiel-Apps wie Aviator hat weitreichende Folgen. Für die Verbraucher schaffen diese Anzeigen ein falsches Gefühl der Sicherheit und des Vertrauens und verleiten sie dazu, sich auf Plattformen einzulassen, die sie sonst vielleicht meiden würden. Die Assoziation mit einer vertrauenswürdigen prominenten Person kann unglaublich überzeugend sein, insbesondere in einem Kontext, in dem Glücksspiel-Apps oft mit Skepsis betrachtet werden.

Darüber hinaus können diese gefälschten Anzeigen zu finanziellen Verlusten und sogar zu rechtlichen Problemen für die Nutzer führen, die Opfer dieser Betrügereien werden. Die trügerische Natur der Anzeigen bedeutet, dass die Nutzer möglicherweise nicht erkennen, dass sie in die Irre geführt werden, bis es zu spät ist, und zu diesem Zeitpunkt haben sie möglicherweise bereits Geld verloren oder ihre persönlichen Daten preisgegeben.

Für die betroffenen Prominenten stellen die Deepfake-Anzeigen einen ernsthaften Eingriff in ihre Privatsphäre und einen Angriff auf ihre persönliche Marke dar. Diese Personen haben ihre Karrieren auf ihrer öffentlichen Person aufgebaut, und die unbefugte Verwendung ihres Abbilds auf solch irreführende Weise kann ihren Ruf schädigen und zu einem Vertrauensverlust bei ihrer Fangemeinde führen.

Rechtliche und ethische Herausforderungen

Das Aufkommen der Deepfake-Technologie in der Werbung wirft erhebliche rechtliche und ethische Fragen auf. Derzeit fehlt es an einer umfassenden Gesetzgebung, die sich mit dem Missbrauch der Deepfake-Technologie befasst, insbesondere im Zusammenhang mit der Werbung. Zwar haben einige Länder damit begonnen, Gesetze einzuführen, die die Verbreitung von Deepfakes eindämmen sollen, doch die Durchsetzung bleibt eine Herausforderung, vor allem wenn die Täter in verschiedenen Rechtsordnungen ansässig sind.

Außerdem bedeutet die rasche Entwicklung der KI-Technologie, dass Deepfakes immer schwieriger zu erkennen sind. Daher müssen digitale Plattformen wie soziale Medien und Videoportale dringend fortschrittlichere Werkzeuge entwickeln, um Deepfakes zu erkennen und zu entfernen, bevor sie Schaden anrichten können.

Fazit

Die Verwendung der Deepfake-Technologie zur Werbung für Glücksspiel-Apps wie Aviator ist ein beunruhigender Trend, der die Schattenseiten der KI-Entwicklung aufzeigt. Während die Technologie an sich neutral ist, ist ihre Anwendung zur Erstellung irreführender Werbung ein klarer Missbrauch, der Risiken für Verbraucher, Prominente und die Integrität der Werbeindustrie birgt.

Angesichts der zunehmenden Verbreitung von Deepfakes ist es für digitale Plattformen, Gesetzgeber und die Öffentlichkeit wichtig, wachsam zu bleiben. Eine stärkere Sensibilisierung, ein strengerer Rechtsrahmen und ausgefeiltere Erkennungsinstrumente sind für die Bekämpfung des Missbrauchs der Deepfake-Technologie unerlässlich. In der Zwischenzeit sollten die Verbraucher Vorsicht und Skepsis walten lassen, wenn sie auf Online-Werbung stoßen, insbesondere auf solche, die von Prominenten beworben wird.

Wer mehr über die Auswirkungen der Deepfake-Technologie erfahren möchte, findet in seriösen Quellen wie Popular Science und Factly detaillierte Einblicke und aktuelle Informationen über die neuesten Entwicklungen in diesem sich schnell entwickelnden Bereich (FACTLY) (Popular Science).

Über den Autor

Experte / Autor des Artikels

Ein Experte im Bereich Glücksspiel und Wetten. Er war früher Profifußballer, beendete aber seine Karriere nach einer Verletzung. Arbeitete für eine große Publikation mit einer 20-jährigen Geschichte im Bereich Glücksspiel. Seine Hobbys sind Angeln und Sportwetten; gelegentlich spielt er auch in Kasinos.