Aviator’ın deepfake teknolojisi kullanılarak nasıl reklamı yapılıyor?

Содержание показать

Deepfake Teknolojisi Kullanılarak Aviator’ın Reklamı Nasıl Yapılıyor?

Yapay zeka (AI) ve deepfake teknolojisinin hızla ilerlemesi, pazarlama ve reklamcılık için yeni yollar açtı, ancak aynı zamanda rahatsız edici bir eğilime de yol açtı: giderek daha popüler hale gelen Aviator oyunu da dahil olmak üzere kumar uygulamalarını tanıtmak için ünlülerin benzerliklerinin yetkisiz kullanımı. Son altı ay içinde, deepfake teknolojisinin Aviator ve benzeri kumar platformlarını destekleyen tanınmış ünlülerin yer aldığı ikna edici ancak hileli reklamlar oluşturmak için nasıl kullanıldığını vurgulayan birkaç rapor ortaya çıktı.

Deepfake Teknolojisini Anlamak

Deepfake teknolojisi, gerçek gibi görünen ancak aslında tamamen uydurma olan son derece gerçekçi video, ses veya görüntüler oluşturmak için yapay zeka ve makine öğrenimi algoritmalarını kullanır. Bu teknoloji bir kişinin yüzünü başka bir bedenin üzerine yerleştirebilir, sesini taklit edebilir ve hatta gerçek gibi görünen tamamen yeni görüntüler oluşturabilir. Deepfake’lerin eğlence ve medyada bazı olumlu uygulamaları olsa da, reklamcılıkta -özellikle de kumar sektöründe- kötüye kullanılmaları önemli bir endişe kaynağı haline gelmiştir.

Aviator ve Ünlü Deepfakes Vakası

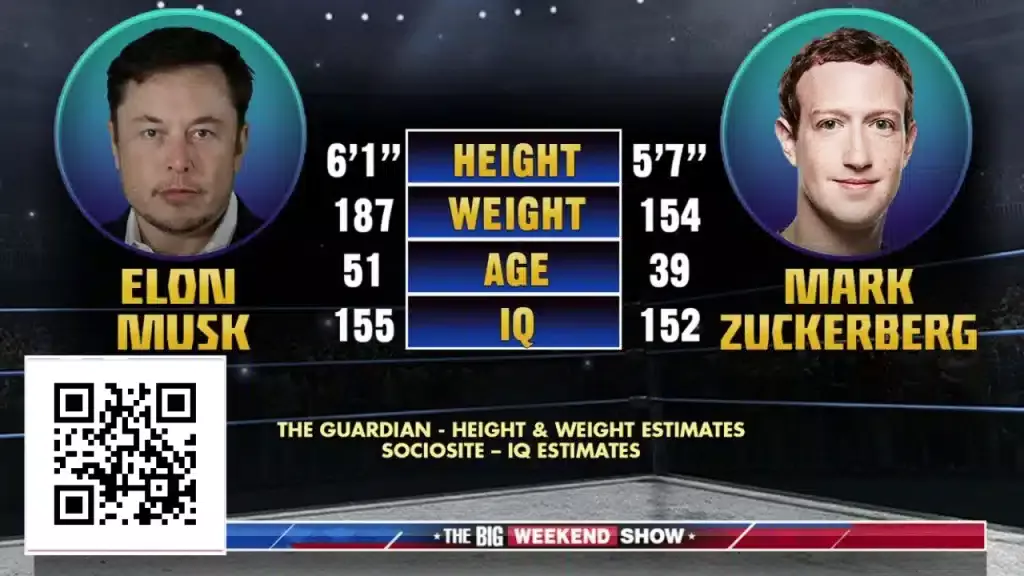

Çevrimiçi kumar çevrelerinde önemli bir popülerlik kazanan çarpışma tarzı bir oyun olan Aviator, oyunu tanıtmak için deepfake kullanan etik olmayan pazarlamacıların hedefi haline geldi. MrBeast, Akshay Kumar ve Virat Kohli gibi ünlülerin yer aldığı deepfake reklamlar sosyal medyada dolaşıyor ve izleyicileri bu kişilerin Aviator oyununu desteklediğine inandırıyor.

MrBeast ve kumar uygulaması

Ekim 2023’te, milyonlarca takipçisi olan en etkili YouTuber’lardan biri olan MrBeast, kendisini bir kumar uygulamasını destekliyormuş gibi gösteren deepfake bir videoyu kamuoyu önünde kınadı. Video, MrBeast’in görünüşünü ve sesini taklit etmek için gelişmiş yapay zeka teknikleri kullanılarak akıllıca tasarlanmış ve sanki uygulamayı gerçekten destekliyormuş gibi görünmesini sağlamıştır. Reklam, kullanıcıların kumar oyunlarını oynayarak önemli miktarlarda para kazanabileceklerini iddia ederek izleyicileri uygulamayı indirmeye ve bahis yapmaya teşvik etti (Vegas Slots Online).

MrBeast sosyal medyayı kullanarak hayranlarını dolandırıcılık konusunda uyardı, onları dikkatli olmaya çağırdı ve sosyal medya platformlarının artan yapay zeka sahteciliği tehdidiyle başa çıkmaya hazır olup olmadığını sorguladı. Açıklamasında, özellikle yeni kullanıcıları çekmek için güven ve güvenilirliğin çok önemli olduğu kumar sektöründe, bu tür teknolojilerin ne kadar kolay kötüye kullanılabileceğine ilişkin daha geniş bir soruna dikkat çekti.

Lots of people are getting this deepfake scam ad of me… are social media platforms ready to handle the rise of AI deepfakes? This is a serious problem pic.twitter.com/llkhxswQSw

— MrBeast (@MrBeast) October 3, 2023

Akshay Kumar’ın Deepfake İkilemi

Benzer şekilde, Bollywood aktörü Akshay Kumar da deepfake kötüye kullanımının bir başka kurbanı oldu. Ağustos 2023’te sosyal medyada Kumar’ın Aviator oyunuyla bağlantılı bir kumar uygulamasını onayladığını gösteren bir video dolaşmaya başladı. Deepfake video, Kumar’ın “OMG 2” adlı filmini tanıttığı gerçek bir videonun ses ve dudak hareketlerinin değiştirilmesiyle oluşturuldu. Manipüle edilen video, izleyicileri aktörün Aviator oyununu desteklediğini düşünmeye sevk etti ki bu iddia Kumar ve ekibi tarafından hızla yalanlandı (FACTLY).

Bu olay, deepfake teknolojisinin karmaşıklığını ve içeriği kötü amaçlarla manipüle etmek için ne kadar kolay kullanılabildiğinin altını çizmektedir. Kumar’ın ekibi deepfake’in yaratıcılarına karşı yasal işlem başlattı, ancak itibarının zedelenmesi ve şüphelenmeyen izleyicilere potansiyel zarar çoktan verilmişti.

Dahası, viral videoyu derin sahte video dedektörlerine tabi tuttuk ve bu dedektörler videonun potansiyel olarak derin bir sahte olduğunu tespit etti.

Virat Kohli ve Aviator Promosyonu

Bir başka endişe verici örnekte, Hintli kriket yıldızı Virat Kohli’nin Aviator oyununu tanıttığı deepfake bir video internette ortaya çıktı. Videoda, Kohli ile yapılan meşru bir röportajın görüntülerini değiştirmek için yapay zeka teknolojisi kullanıldı ve sanki Kohli kumar uygulamasını destekliyormuş gibi göründü. Bu deepfake özellikle ikna ediciydi çünkü Kohli’nin sesini taklit etmek için ses klonlama teknolojisini içeriyordu ve sahte reklama daha da özgün bir hava katıyordu (FACTLY).

Hedef alınan diğer ünlüler gibi Kohli’nin de Aviator oyununun tanıtımı hakkında hiçbir bilgisi veya dahli yoktu. Deepfake sadece hayranları yanlış yönlendirmekle kalmadı, aynı zamanda sahte onaylara dayanarak uygulamayı indirip kullanmaya meyilli olabilecek kişiler için de önemli bir risk oluşturdu.

Deepfake Reklamcılığın Etkisi

Aviator gibi kumar uygulamalarının reklamını yapmak için deepfake kullanımının geniş kapsamlı etkileri vardır. Tüketiciler için bu reklamlar sahte bir güvenlik ve güven duygusu yaratarak, aksi takdirde kaçınabilecekleri platformlarla etkileşime girmelerine yol açıyor. Güvenilir bir ünlüyle kurulan ilişki, özellikle kumar uygulamalarına genellikle şüpheyle bakıldığı bir bağlamda inanılmaz derecede ikna edici olabilir.

Dahası, bu deepfake reklamlar, dolandırıcılığa kurban giden kullanıcılar için mali kayıplara ve hatta yasal sorunlara yol açabilir. Reklamların aldatıcı doğası, kullanıcıların çok geç olana kadar yanlış yönlendirildiklerini fark edemeyebilecekleri anlamına gelir; bu noktada zaten para kaybetmiş veya kişisel bilgilerini tehlikeye atmış olabilirler.

Söz konusu ünlüler için deepfake reklamlar ciddi bir mahremiyet ihlali ve kişisel markalarına yönelik bir saldırı anlamına gelmektedir. Bu kişiler kariyerlerini kamuya açık kişilikleri üzerine inşa etmişlerdir ve benzerliklerinin bu şekilde aldatıcı bir şekilde izinsiz kullanılması itibarlarına zarar verebilir ve hayran kitleleri arasında güven kaybına yol açabilir.

Yasal ve Etik Zorluklar

Reklamcılıkta deepfake teknolojisinin yükselişi, önemli yasal ve etik soruları gündeme getirmektedir. Şu anda, özellikle reklamcılık bağlamında deepfake teknolojisinin kötüye kullanımını ele alan kapsamlı bir mevzuat eksikliği bulunmaktadır. Bazı ülkeler deepfake’lerin yayılmasını engellemeyi amaçlayan yasalar çıkarmaya başlamış olsa da, özellikle failler farklı yargı bölgelerinde bulunduğunda, uygulama bir zorluk olmaya devam etmektedir.

Ayrıca, yapay zeka teknolojisinin hızla gelişmesi, deepfake’lerin tespit edilmesinin giderek zorlaştığı anlamına gelmektedir. Bu durum, sosyal medya ve video paylaşım siteleri gibi dijital platformların, deepfake içerikleri zarar vermeden önce tespit etmek ve kaldırmak için daha gelişmiş araçlar geliştirmelerine yönelik acil bir ihtiyaç yaratmaktadır.

Sonuç

Aviator gibi kumar uygulamalarının reklamını yapmak için deepfake teknolojisinin kullanılması, yapay zeka gelişmelerinin karanlık tarafını vurgulayan rahatsız edici bir eğilimdir. Teknolojinin kendisi tarafsız olsa da, aldatıcı reklamlar yaratmadaki uygulaması tüketiciler, ünlüler ve reklam endüstrisinin bütünlüğü için risk oluşturan açık bir kötüye kullanımdır.

Deepfake’ler yaygınlaştıkça, dijital platformların, kanun koyucuların ve halkın tetikte olması çok önemlidir. Artan farkındalık, daha güçlü yasal çerçeveler ve daha sofistike tespit araçları deepfake teknolojisinin kötüye kullanımıyla mücadelede elzemdir. Bu arada tüketiciler, özellikle ünlülerin onaylarını içeren çevrimiçi reklamlarla karşılaştıklarında dikkatli ve şüpheci davranmalıdır.

Deepfake teknolojisinin sonuçları hakkında daha fazla bilgi edinmek isteyenler için Popular Science ve Factly gibi saygın kaynaklar, hızla gelişen bu alandaki en son gelişmeler hakkında ayrıntılı bilgiler ve güncellemeler sunmaktadır (FACTLY) (Popular Science).

Yazar hakkında

Uzman / Makalenin Yazarı

Kumar ve bahis sektöründe bir uzman. Eskiden profesyonel bir futbolcuydu, ancak sakatlandıktan sonra kariyerini sonlandırdı. Kumar haberlerinde 20 yıllık geçmişi olan büyük bir yayın için çalışmıştır. Hobileri balık tutmak ve spor bahisleri oynamak; ayrıca zaman zaman kumarhanelerde kumar oynuyor.