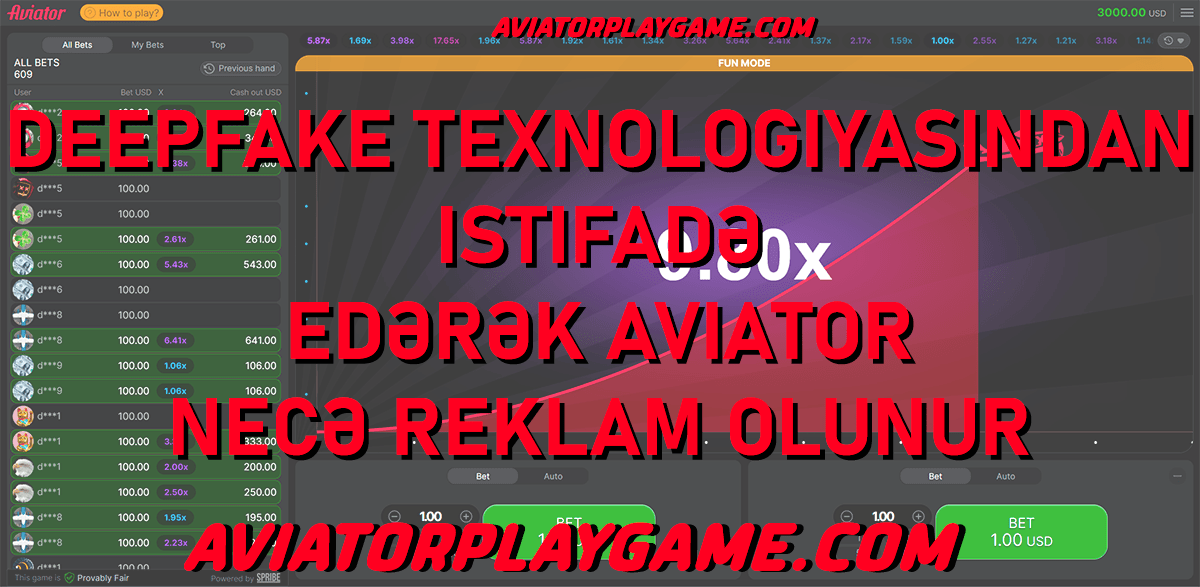

Deepfake texnologiyasından istifadə edərək Aviator necə reklam olunur

Süni intellektin (AI) və deepfake texnologiyasının sürətli inkişafı marketinq və reklam üçün yeni imkanlar açdı, lakin bu, həm də narahatedici tendensiyaya səbəb oldu: qumar proqramlarını, o cümlədən getdikcə populyarlaşan Aviator oyununu tanıtmaq üçün məşhurların oxşarlarından icazəsiz istifadə. Son altı ayda, Aviator və oxşar qumar platformalarını dəstəkləyən tanınmış məşhurların yer aldığı inandırıcı, lakin saxta reklamlar yaratmaq üçün deepfake texnologiyasından necə istifadə edildiyini vurğulayan bir neçə hesabat ortaya çıxdı.

Deepfake Texnologiyasını Anlamaq

Deepfake texnologiyası AI və maşın öyrənmə alqoritmlərindən real görünən, lakin əslində tamamilə uydurulmuş yüksək realistik video, audio və ya şəkillər yaratmaq üçün istifadə edir. Bu texnologiya bir insanın üzünü başqa bir bədənə əlavə edə, səsini təqlid edə və hətta orijinal görünən tamamilə yeni görüntülər yarada bilər. Deepfakes əyləncə və mediada bəzi müsbət tətbiqlərə malik olsa da, onların reklamda, xüsusən də qumar sənayesində sui-istifadəsi ciddi narahatlıq doğurur.

Aviator və Məşhur Deepfakes nümunəsi

Onlayn qumar çevrələrində əhəmiyyətli dərəcədə populyarlıq qazanmış qəza tipli oyun Aviator, oyunu tanıtmaq üçün deepfakes istifadə edən qeyri-etik marketoloqların hədəfinə çevrilib. MrBeast, Akshay Kumar və Virat Kohli kimi məşhurların yer aldığı dərin saxta reklamlar sosial mediada yayılaraq izləyiciləri bu rəqəmlərin Aviator oyununu dəstəklədiyinə inandıraraq aldadır.

MrBeast və qumar proqramı

2023-cü ilin oktyabrında milyonlarla izləyicisi olan ən nüfuzlu YouTuberlərdən biri olan MrBeast, onun qumar proqramını təbliğ edərkən saxta şəkildə təsvir olunduğu dərin saxta videonu açıq şəkildə qınadı. Video MrBeast-in görünüşünü və səsini təqlid etmək üçün qabaqcıl süni intellekt üsullarından istifadə edərək, o, proqramı həqiqətən təsdiqləyirmiş kimi görünmək üçün ağıllı şəkildə hazırlanmışdır. Reklamda istifadəçilərin qumar oyunları oynayaraq böyük məbləğdə pul qazana biləcəyi, tamaşaçıları proqramı yükləməyə və mərc etməyə (Vegas Slots Online) sövq etməklə yalan iddia edilirdi.

MrBeast, pərəstişkarlarını fırıldaqçılıq barədə xəbərdar etmək üçün sosial mediaya müraciət etdi, onları ehtiyatlı olmağa çağırdı və sosial media platformalarının AI dərin saxtakarlığının artan təhlükəsini idarə etməyə hazır olub olmadığını soruşdu. Onun bəyanatı bu cür texnologiyanın, xüsusən də yeni istifadəçiləri cəlb etmək üçün inam və etibarlılığın vacib olduğu qumar sektorunda necə asanlıqla sui-istifadə edilə biləcəyi ilə bağlı daha geniş məsələni vurğuladı.

Lots of people are getting this deepfake scam ad of me… are social media platforms ready to handle the rise of AI deepfakes? This is a serious problem pic.twitter.com/llkhxswQSw

— MrBeast (@MrBeast) October 3, 2023

Akshay Kumarın dərin saxta dilemması

Eynilə, Bollivud aktyoru Akshay Kumar dərin saxta istifadənin növbəti qurbanı oldu. 2023-cü ilin avqustunda sosial mediada Kumarın Aviator oyunu ilə əlaqəli qumar tətbiqini dəstəklədiyini göstərən bir video yayılmağa başladı. Deepfake videosu Kumarın “OMG 2” filmini təbliğ edən orijinal videosunun audio və dodaq hərəkətlərini dəyişdirməklə yaradılmışdır. Manipulyasiya edilmiş video tamaşaçıları aktyorun Aviator oyununu dəstəklədiyini düşünərək çaşdırdı, Kumar və komandası tez bir zamanda bu iddianı təkzib etdilər (FACTLY).

Bu hadisə deepfake texnologiyasının mükəmməlliyini və ondan çirkin məqsədlər üçün məzmunu manipulyasiya etmək üçün istifadə oluna biləcəyini vurğulayır. Kumarın komandası deepfake yaradıcılarına qarşı qanuni tədbirlər gördü, lakin onun reputasiyasına və şübhəsiz izləyicilərə potensial zərər artıq edilib.

Bundan əlavə, biz viral videonu dərin saxta video detektorlarına məruz qoymuşuq və onlar onun potensial olaraq dərin saxta olduğunu müəyyən ediblər.

Virat Kohli və Aviator Promotion

Başqa bir həyəcanverici vəziyyətdə, hindistanlı kriket ulduzu Virat Kohlinin Aviator oyununu təbliğ edən dərin saxta videosu internetdə ortaya çıxdı. Videoda Kohli ilə qanuni müsahibədən görüntüləri dəyişdirmək üçün süni intellekt texnologiyasından istifadə edilib və onun qumar proqramını dəstəklədiyi görünürdü. Bu dərin saxtakarlıq xüsusilə inandırıcı idi, çünki o, Kohlinin səsini təkrarlamaq üçün səs klonlama texnologiyasını özündə birləşdirdi və saxta reklama daha da orijinallıq havası verdi (FACTLY).

Hədəflənən digər məşhurlar kimi, Kohlinin də Aviator oyununun tanıtımında heç bir məlumatı və ya iştirakı yox idi. Deepfake nəinki pərəstişkarlarını çaşdırdı, həm də yalançı təsdiq əsasında proqramı endirmək və istifadə etmək şirnikləndiricisi ola bilənlər üçün əhəmiyyətli risk yaratdı.

Deepfake Reklamın Təsiri

Aviator kimi qumar proqramlarını reklam etmək üçün dərin saxtakarlıqlardan istifadənin geniş təsirləri var. İstehlakçılar üçün bu reklamlar saxta təhlükəsizlik və inam hissi yaradır və onları əks halda qaça biləcəkləri platformalarla əlaqə saxlamağa vadar edir. Etibarlı bir məşhurla əlaqə inanılmaz dərəcədə inandırıcı ola bilər, xüsusən də qumar proqramlarına tez-tez şübhə ilə baxıldığı bir kontekstdə.

Üstəlik, bu dərin saxta reklamlar fırıldaqların qurbanı olan istifadəçilər üçün maliyyə itkilərinə və hətta hüquqi problemə səbəb ola bilər. Reklamların aldadıcı xarakteri o deməkdir ki, istifadəçilər çox gec olana qədər aldadıldıqlarını dərk edə bilməzlər, bu zaman onlar artıq pul itirmiş və ya şəxsi məlumatlarını ələ keçirmiş ola bilərlər.

İştirak edən məşhurlar üçün dərin saxta reklamlar məxfiliyə ciddi müdaxilə və onların şəxsi brendinə hücumu təmsil edir. Bu şəxslər öz ictimai şəxsiyyətləri üzərində karyera qurublar və onların oxşarlığından bu cür aldadıcı şəkildə icazəsiz istifadə onların reputasiyasına xələl gətirə və azarkeş kütləsi arasında etibarın itirilməsinə səbəb ola bilər.

Hüquqi və Etik Problemlər

Deepfake texnologiyasının reklamda yüksəlişi əhəmiyyətli hüquqi və etik suallar doğurur. Hal-hazırda, xüsusilə reklam kontekstində deepfake texnologiyasından sui-istifadə hallarını həll edən hərtərəfli qanunvericilik yoxdur. Bəzi ölkələr “deepfakes”in yayılmasının qarşısını almağa yönəlmiş qanunlar tətbiq etməyə başlasalar da, xüsusilə də cinayətkarlar müxtəlif yurisdiksiyalarda yerləşdikdə, icra problemi olaraq qalır.

Bundan əlavə, süni intellekt texnologiyasının sürətli inkişafı o deməkdir ki, dərin saxtakarlıqları aşkar etmək getdikcə çətinləşir. Bu, sosial media və video paylaşma saytları kimi rəqəmsal platformalara dərin saxta məzmunu zərər vermədən əvvəl müəyyən etmək və silmək üçün daha təkmil alətlər hazırlamağa ciddi ehtiyac yaradır.

Nəticə

Aviator kimi qumar proqramlarını reklam etmək üçün deepfake texnologiyasından istifadə süni intellekt inkişaflarının qaranlıq tərəflərini vurğulayan narahatedici tendensiyadır. Texnologiyanın özü neytral olsa da, onun aldadıcı reklamların yaradılmasında tətbiqi istehlakçılar, məşhurlar və reklam sənayesinin bütövlüyü üçün risklər yaradan açıq-aydın sui-istifadədir.

Deepfakes daha çox yayıldıqca, rəqəmsal platformalar, qanunvericilər və ictimaiyyət üçün ayıq qalmaq çox vacibdir. Deepfake texnologiyasının sui-istifadəsi ilə mübarizədə artan məlumatlılıq, daha güclü qanunvericilik bazaları və daha mürəkkəb aşkarlama vasitələri vacibdir. Bu arada, istehlakçılar onlayn reklamlarla, xüsusən də məşhurların təsdiqini ehtiva edən reklamlarla qarşılaşdıqda ehtiyatlı və şübhə ilə yanaşmalıdırlar.

Deepfake texnologiyasının təsirləri haqqında daha çox öyrənmək istəyənlər üçün Popular Science və Factly kimi nüfuzlu mənbələr bu sürətlə inkişaf edən sahədə (FACTLY) (Populyar Elm) ən son inkişaflar haqqında ətraflı məlumat və yeniləmələr təklif edir.

Müəllif haqqında

Ekspert / məqalə müəllifi

Qumar və totalizator sənayesində mütəxəssis. Əvvəllər peşəkar futbolçu idi, lakin zədə səbəbindən karyerasını başa vurdu. Qumar xəbərləri sahəsində 20 illik tarixi olan böyük bir nəşrdə işləmişdir. Hobbi balıqçılıq və İdman bahisləridir; bəzən kazinolarda da qumar oynayır.